在当今科技飞速发展的时代背景下,大语言模型(llm)*的崛起标志着人工智能(ai)领域进入了新的发展阶段。各大科创巨头竞相投入研发,不断推出具有划时代意义的大语言模型。人工智能已经深入渗透社会的各个领域,成为推动经济发展、提升生产效率、优化用户体验的关键力量。作为全球前沿科技先驱,理光始终秉持前瞻视野,引领创新前沿,致力于人工智能领域的课题发掘与技术突破,为行业企业提供尖端数字化凯发k8官方旗舰厅的解决方案。2024年6月3日,理光利用和日本理化学研究所创新智能综合研究中心共同研发得到的指令数据,训练理光的日语大语言模型,成功提高了模型的指令遵循性能,昭示在日语大语言模型的研发领域取得了重要突破。

攻坚克难,日语大语言模型性能显著提升

日语大语言模型的发展路上一直存在着诸多困难。与英语国家围绕llm研发的激烈竞争相比,日语大语言模型的研发相对滞后,这主要是因为日语的语法和表达与英语存在显著差异,以英语为基础的模型难以充分发挥功能。此外,日语数据的收集和完善也面临许多挑战,如数据量少、品质和多样性不足等问题。

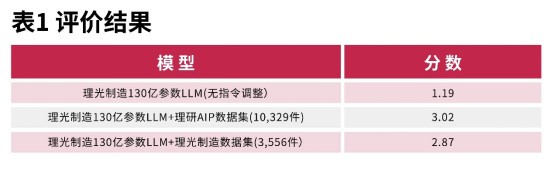

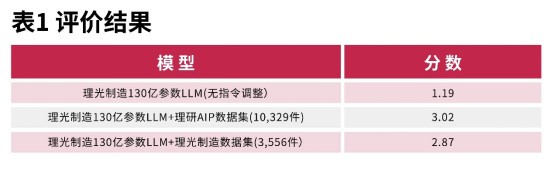

然而,理光凭借其深厚的技术底蕴和不断进取的创新能力,成功克服了这些挑战。通过与日本理化学研究所的紧密合作,理光得到了适用于日语的指令数据,并成功应用于llm的训练中。数据显示,理光使用指令数据 "ichikara-instruction"(10329 条指令)对公司研发的130亿参数日语大语言模型进行了指令调优。指令调优是训练llm的关键环节,旨在缩小模型的预测目标与用户期望的模型遵循人类指令的目标之间的差距。结果,在包含复杂指令和任务的典型基准 elyza-tasks-100 中,与调优前相比,指令跟踪性能得到了显著提高。此外,使用理光公司最初开发的 3,556 条指令数据的调优结果也显示,在同一基准测试中的得分也有类似的显著提高。表1数据显示,经过调优,llm的指令遵循性能得分从1.19分大幅提高至3.02分,标志着模型在理解和执行人类指令方面取得了显著进步,也揭示了对于提高 llm 性能而言,重要的不仅是数据量的大小,数据本身的质量对提高成绩也很重要。这一重大进展不仅再次凸显了理光在前沿科技研发领域的雄厚实力,更为日语大语言模型的探索、优化与创新树立了崭新的行业标杆。

表2数据对摘要任务的独立评估则更进一步证实了理光数据集的优越性,尤其是在长文本摘要方面。理光深知基于人工智能的摘要生成功能对于客户而言具有极高的需求,因此将其作为重点研发领域。为了满足这一需求,理光正持续投入于数据开发,成果显著。截至2024年5月底,已成功完成了超过5000个教学数据集的开发工作。这些精心打造的数据集将在今后广泛应用于理光提供的各类人工智能凯发k8官方旗舰厅的解决方案中,确保为客户提供更加卓越、高效的服务体验。

数字赋能,人工智能助力企业数字化转型

在数字化转型的浪潮中,理光凭借其在数字化服务领域的实践积累,结合前沿科技领域的技术突破,致力于为企业提供全面、高效的数字化凯发k8官方旗舰厅的解决方案。在日本当前劳动力减少和老龄化的社会背景下,许多公司开始关注在运营工作中使用人工智能,以提高生产率和实现高附加值的工作方式。要使人工智能真正融入并助力企业的日常业务运营,关键一步是量身定制一个专为企业打造的人工智能模型(专用llm)。这个模型并不通用,需要投入大量精力与数据训练(包含行业知识、业务细节与企业专业术语、短语),专用llm才能精准地理解企业业务需求,从而在实际应用中发挥出更大的价值。

理光利用自身研发的日语大语言模型,结合企业特有的信息和知识,开发出适用于各个领域的高精度人工智能模型。这些模型不仅易于定制化生产,而且高度适应日语语法,答案准确性有保证,能够充分利用日本公司的信息资产。据了解,自2024年4月开始,理光开始在云环境中提供专用llm。理光将继续支持客户开展办公室和工作场所的数字化转型,提供符合客户需求并可根据其行业业务使用的人工智能服务。未来,理光还将结合具体工作场景开创更多基于专用llm的人工智能工具,为企业的数字化转型保驾护航。

履及未踏之地,再铸科技结晶。理光在日语大语言模型研发领域的这一重要突破,不仅展现了其当前在人工智能技术上的领先地位与深厚底蕴,也为面临转型困难,聚焦数字技术的企业开辟了新的道路。理光将继续深化各界合作,推动人工智能技术在更多领域的应用与发展,携手凯发官网入口首页的合作伙伴共创更加智能、人人“悦享工作”的数字未来。

*llm:large language model(大型语言模型)。通过理解句子中相隔较远的单词之间的关系,结合上下文的语言环境,来处理自然语言中存在的有多重含义和有歧义的内容。这项技术可以像人类一样精确地执行“回答自然句子问题”和“文档摘要提炼”等指令过程,而且也很容易学习。

本文属于原创文章,如若转载,请注明来源:引领人工智能创新发展,理光在日语大语言模型研发取得重要突破https://pad.zol.com.cn/882/8829880.html